更少GPU卻更強 :LLM輕量化壓縮及加速訓練 梁志遠

網路價

NT${{ commaFormat(product.price_actu) }}

NT${{commaFormat(product.price_sugg)}}

專屬特惠價 NT${{ commaFormat(product.group_price) }}

優惠價

NT${{ commaFormat(product.member_price) }}

NT${{ commaFormat(product.group_price) }}

商品組合

贈品 (買就送)

{{ pItem.title }}

付款方式

轉帳/匯款/無摺存款/(至總店取貨時使用文化幣) / LinePay付款 / 超商代碼付款(綠界金流) / 信用卡一次付清(綠界金流) / 信用卡分6期(藍新金流) / 信用卡分12期(綠界金流) / AFTEE 先享後付 / [圖書專用] 7-11取貨付款(限1000~3000元訂單使用)

配送方式

7-11超商取貨 / 全家超商取貨 / 宅配到家 / 校園書局門市取貨(取貨加碼送5元折價)

超值加購

{{ pItem.title }}

型號:{{ pItem.model }}

加購價 NT${{pItem.extra_price}}

(原價NT${{pItem.price_orig}})

出版商:深智

出版日期:2025-12-19

語言:繁體中文

頁數:552

ISBN-13:

9786267757604

【內容】

【內容特點】

★Transformer與MoE架構計算特性

★模型壓縮技術:量化、剪枝、蒸餾

★混合精度訓練與分散式訓練架構

★ONNX與TensorRT格式轉換流程

★運算圖最佳化:融合、重寫、記憶體配置

★端側學習與聯邦學習通訊機制

★IR中介表示與計算圖優化策略

★動態Batch與記憶體排程機制

★cuDNN與MKLDNN運算元庫應用

★CUDA核心函數與GPU記憶體管理

★Vulkan推理加速與圖形並行整合

★OpenCL與AVX跨平台加速

★DeepSeek-V3訓練與推理結構

★FP8精度訓練與Sigmoid路由演算法

【內容簡介】

本書從工程實作與架構設計的角度出發,系統地整理了大模型在實際部署中的資源瓶頸與解決方案。從Transformer與MoE架構切入,解析其帶來的計算與儲存壓力,並延伸至量化、剪枝、知識蒸餾等主流模型壓縮技術的原理與實作要點。書中不僅整理了各類加速方法,如混合精度訓練、分散式架構與推理引擎建構,還提供跨框架的模型格式轉換範例,涵蓋ONNX、TensorRT等工具鏈整合流程。進一步深入端側學習、IR最佳化與動態Batch記憶體管理等核心技術,並透過cuDNN、MKLDNN、CUDA與Vulkan等元件展示運算元優化的具體實作。本書最大特點是涵蓋理論與部署細節,並以DeepSeek-V3為案例展現整體技術鏈條如何協同降本增效。對於實際從事大模型研發、推理部署或系統最佳化的工程人員而言,是一本兼顧理論深度與實務操作的實用指南。

▌第一部分 大模型概述與核心最佳化技術

►第1章 大模型基本概念

1.1 大模型的興起與發展

1.1.1 大規模神經網路

1.1.2 Transformer 編碼器-解碼器

1.1.3 MoE 架構

1.2 運算資源與性能瓶頸

1.2.1 GPU 簡介

1.2.2 TPU 簡介

1.2.3 網路頻寬約束與分散式訓練

1.2.4 大模型的訓練時間與運算資源消耗問題

1.3 資料與隱私問題

1.3.1 急劇增加的資料量

1.3.2 資料隱私保護與符合規範性

1.4 模型部署與運行維護

1.4.1 模型部署基本概念

1.4.2 雲端運算與邊緣計算

1.4.3 端側部署

1.4.4 大模型執行與維護

1.5 本章小結

1.6 思考題

►第2 章 模型壓縮、訓練與推理

2.1 模型壓縮概述

2.1.1 模型壓縮簡介

2.1.2 常見的模型壓縮方法分類

2.2 訓練加速基礎

2.2.1 資料並行與模型並行

2.2.2 混合精度訓練

2.2.3 分散式訓練框架:Horovod

2.3 推理加速基礎

2.3.1 硬體加速與推理引擎

2.3.2 低延遲與高輸送量平衡

2.3.3 推理最佳化實戰:批次推理

2.4 性能評估指標

2.4.1 計算複雜度與性能指標

2.4.2 延遲、輸送量與精度之間的權衡

2.4.3 評估工具與基準測試

2.5 本章小結

2.6 思考題

►第3 章 模型格式轉換

3.1 模型格式的定義與轉換

3.1.1 常見的模型格式:ONNX、TensorFlow 的SavedModel

3.1.2 模型格式轉換實現

3.1.3 模型的相容性問題

3.2 跨框架模型轉換

3.2.1 TensorFlow 到PyTorch 的模型轉換

3.2.2 ONNX 與TensorFlow、PyTorch 的相容性

3.2.3 轉換時的精度損失問題

3.3 硬體相關的格式轉換

3.3.1 從PyTorch 到TensorRT

3.3.2 ONNX 模型與NVIDIA TensorRT 的相容性

3.3.3 模型格式與硬體加速的關係

3.4 模型格式轉換的工具與函式庫

3.4.1 使用ONNX 進行跨平臺轉換

3.4.2 TensorFlow Lite 與Edge 模型最佳化

3.5 本章小結

3.6 思考題

►第4 章 圖最佳化

►第5 章 模型壓縮

▌第二部分 端側學習與高效計算引擎最佳化

►第6 章 端側學習、端側推理及計算引擎最佳化

►第7 章 高性能運算子函式庫簡介

▌第三部分 高性能運算子與深度學習框架應用

►第8 章 常用高性能運算子開發實戰

►第9 章 TIK、YVM 運算子原理及其應用

►第10 章 基於DeepSeek-V3 分析大模型訓練降本增效技術

【關於教科書訂購說明】

☆ 單本即有折扣,將商品放入購物車就可以看見優惠價唷!五本以上團購更便宜!加入會員訂購,還可累積購物金!

★ 若有急需用書,可先LINE私訊詢問庫存呦~

☆ 出貨時間:有現貨的,2個工作日內出貨;無現貨,約3~5個工作日 出貨

【寄送方式說明】

❶ 實體門市取貨

全台麗文校園書局皆可取貨,貨到書局將會以簡訊通知。

❷ 超商取貨

提供7-11及全家超商取貨(需先付款,無貨到付款)。

❸ 一般宅配

本公司主要與黑貓宅急便配合,送達到您指定的地址。

※當您於本網站消費交易完成後,電子發票將會以電子郵件寄給您;如需紙本發票請於下訂時於備註欄位說明。

【付款方式說明】

❶ ATM轉帳、匯款

銀行│第一銀行-三民分行

代號│007

戶名│麗文文化事業股份有限公司

帳號│704-10-051861

※實體ATM每日轉帳最高限額為3萬,若訂購金額超過3萬元,請分兩天或是使用不同的銀行帳戶轉帳。

❷ 信用卡(可分期,需負擔手續費)

凡各家銀行的VISA、MASTER、Union Pay、JCB信用卡皆可使用。

![]()

❺ 超商代碼

系統會發送繳費代碼至您的電子信箱,需自行至「超商機器ex:iBon」輸入代碼,產生繳費單後前往櫃檯繳費。

❼ 免卡分期

麗文校園購與「zingala銀角零卡」「第一資融」以及「皮路後支付」合作,讓您免用信用卡就可以購物。

如有使用上的問題,可以先與揪小編聯絡唷!。

※請注意:超過7天未付款之訂單則訂單自動失效;免卡分期訂單成立起7天內未主動聯繫亦同。

【其他說明】

❶關於出貨

1.商品為不缺貨前提下,訂單完成付款後2-4個工作天將會出貨(不含例假日及國定假日);若商品缺貨則須等待1-2週。

2.麗文校園揪來玩保留訂單接受與否權利,若因交易條件有誤或有其他情形導致我們無法接受您的訂單,將以E-mail發送取消訂單通知給您,造成不便敬請見諒。

❷關於退貨

1.非門市現場消費享有七天猶豫期,收到商品當天往後算七天內若是決定不買,則協助不要拆封,一拆封視同願意購買。

2.若真的決定不購買商品要退貨,請聯繫我們LINE線上客服,我們會盡速為您處理。

❸關於新品瑕疵與維修保固

1.全新商品享有購買七日內,新品瑕疵的換新保障;但新品瑕疵與否,是由商品代理商或原廠所判定,麗文校園揪來玩僅能依據判定的結果給予協助。若是原廠判定非新品瑕疵則無法換新,需改為維修的方式處理。

2.新品瑕疵換新的作業時間,將依各廠商的流程而定,最快2個工作天,慢的話也可能需要到15個工作天。

3.購買超過七日後,維修服務由原廠提供。如有需要維修,麗文校園揪來玩可以代為送修,但送修如需運費時(EX:原廠沒有提供免費收件服務),則需由您負擔送修的運費(運費約為100元起,因商品大小而異)。

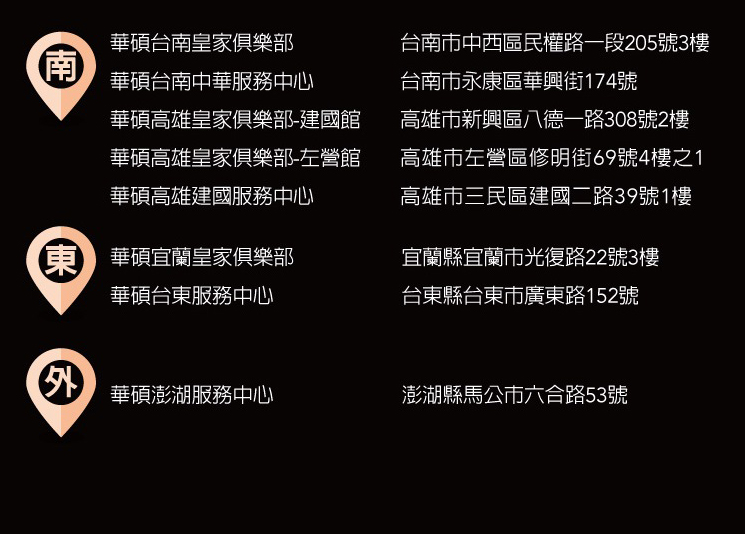

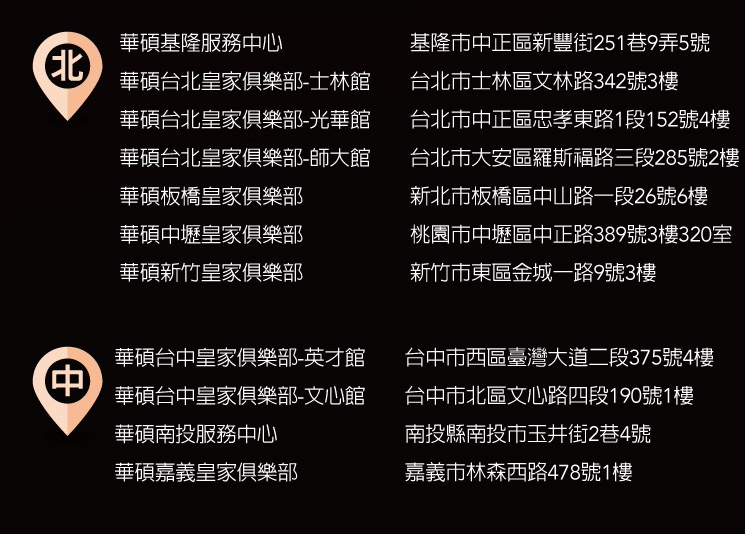

【華碩的維修服務】